Verbindung zu Databricks

Um ein Databricks Lakehouse mit der DQC Platform zu verbinden, werden einige zentrale Konfigurationsdaten benötigt. Diese Anleitung erklärt alle notwendigen Felder, die Erstellung eines Zugriffstokens und die Einrichtung der Berechtigungen.

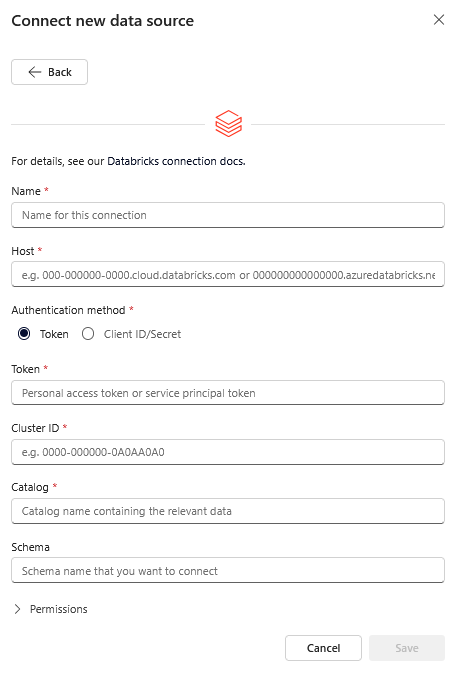

Required connection details

Feld | Beispiel | Beschreibung |

|---|---|---|

Name |

| Beliebiger interner Name für die Verbindung |

Host |

| Host aus der URL nach Anmeldung in Databricks: |

Token (dev) |

| Zugriffstoken – siehe Anleitung unten |

Service Principal (prod) | Client ID: | In Azure Databricks: User icon > Settings > Identity and Access > Service Principals |

Cluster ID |

| In Databricks, ID eines Clusters – in der URL bei geöffnetem Cluster ersichtlich |

Catalog |

| Katalog, der das gewünschte Schema und die Tabellen enthält |

Schema |

| Ziel-Schema zur Anbindung |

Diese Werte werden im Konfigurationsformular der DQC Platform eingetragen

Diese Werte werden im Konfigurationsformular der DQC Platform eingetragen

Databricks-Zugriffstoken erstellen

Für die Verbindung wird ein Zugriffstoken benötigt. Es wird empfohlen, einen Service Principal zu verwenden.

Option 1: Service Principal (empfohlen)

Service Principal erstellen

Einen neuen Principal über die Databricks API anlegen (siehe Anleitung für Azure Databricks)

Die Application ID notieren

Token-Nutzung erlauben

In Databricks dem Principal die Berechtigung zum Verwenden von Tokens geben (siehe Token Permissions)

Zugriffstoken erzeugen

Token mit

"lifetime_seconds": nullerstellenToken sicher aufbewahren Instructions

Option 2: Persönliches Token (für Entwicklung)

In Databricks zu User Settings > Developer Tools gehen

Ein persönliches Zugriffstoken erzeugen

Token sicher speichern

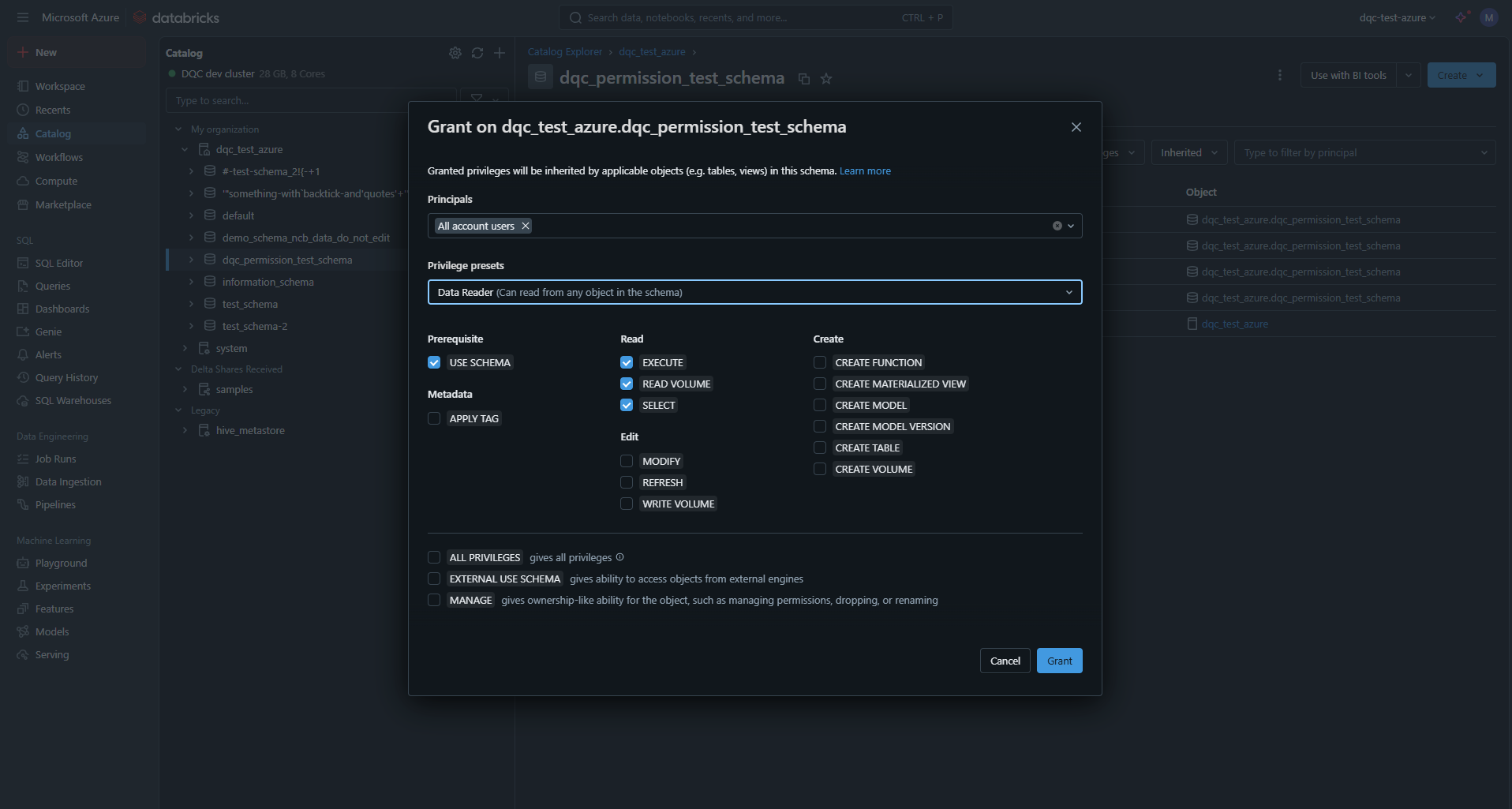

Zugriff auf das Zielschema gewähren

Damit die DQC Platform Daten lesen kann, muss dem entsprechenden Nutzer oder Service Principal die Rolle Data Reader im gewünschten Schema zugewiesen werden.

Außerdem müssen für Databricks SQL Warehouse-Verbindungen temporäre In-Memory-Tabellen erstellt werden über:

GRANT CREATE VOLUME ON SCHEMA <schema> TO <service_principal>;oder:

GRANT CREATE VOLUME ON CATALOG <catalog> TO <service_principal>;  Berechtigungen im Unity Catalog auf Schema-Ebene vergeben

Berechtigungen im Unity Catalog auf Schema-Ebene vergeben

Databricks Unity Catalog Berechtigungsanforderungen

Warum benötigt DQC.ai die CREATE VOLUME-Berechtigung?

Bei der Verwendung von DQC.ai mit Databricks Unity Catalog benötigt Ihr technischer Service-User die CREATE VOLUME-Berechtigung. Dies ist eine rein technische Anforderung für die Abfrageausführung und stellt KEIN Sicherheitsrisiko für Ihre Daten dar.

Wofür diese Berechtigung verwendet wird

Ausschließlich für temporäres Abfrage-Staging

Die CREATE VOLUME-Berechtigung wird ausschließlich zum Erstellen temporärer Staging-Bereiche während der Abfrageausführung verwendet. So funktioniert es:

Während der Abfrageausführung: Wenn DQC.ai Ihre Daten verarbeitet, muss der Connector Zwischenergebnisse und In-Memory-Datenstrukturen temporär bereitstellen

Temporäre Volumes werden erstellt: Diese Volumes dienen als temporärer Scratch-Space für die Abfrageausführung - ähnlich wie temporäre Tabellen, aber für dateibasierte Operationen

Automatische Bereinigung: Diese temporären Volumes werden nach Abschluss der Abfrageausführung automatisch bereinigt

Was diese Berechtigung NICHT tut

Gewährt KEINEN Zugriff zum Lesen Ihrer bestehenden Daten

Gewährt KEINEN Zugriff zum Lesen Ihrer bestehenden Daten Erlaubt KEINE permanenten Änderungen an Ihren Daten

Erlaubt KEINE permanenten Änderungen an Ihren Daten Gewährt KEINEN Zugriff auf andere Catalogs, Schemas oder Tabellen

Gewährt KEINEN Zugriff auf andere Catalogs, Schemas oder Tabellen Umgeht NICHT Ihre bestehenden Datenzugriffskontrollen

Umgeht NICHT Ihre bestehenden Datenzugriffskontrollen

Technischer Hintergrund

Warum nicht einfach Leseberechtigungen verwenden?

Sie fragen sich vielleicht: "Wenn DQC.ai nur Daten liest, warum benötigt es dann CREATE VOLUME?"

Der Databricks SQL Connector (im Gegensatz zu PySpark) kann Abfragen nicht direkt auf reinen In-Memory-Datenstrukturen ausführen. Wenn der DQC-Connector folgendes benötigt:

DataFrames oder Tabellen verarbeiten

Temporäre Lookup-Tabellen für Joins erstellen

Zwischenergebnisse bei komplexen Transformationen bereitstellen

...muss er diese Daten an einem Ort materialisieren, auf den Databricks Compute zugreifen kann. Unity Catalog Volumes sind der verwaltete Mechanismus für dieses dateibasierte Staging.

Statische IP-Adresse der DQC Platform freigeben

Stelle sicher, dass folgende IP-Adresse in der Netzwerkkonfiguration freigegeben ist:

3.123.94.228 Hinweise

Hinweise

Für produktive Umgebungen wird die Verwendung eines Service Principals empfohlen

Die Verbindung ist verschlüsselt und erfolgt mit Lesezugriff

Mehr erfahren: Supported data sources, Azure SQL connection, Connection to Snowflake