DQC Whitepaper

AI Agenten für Datenqualität und Verbesserung

Unternehmen wissen seit Jahrzehnten, dass ihre Daten fehlerhaft sind, doch die Lösungen, um diese Probleme wirklich zu beheben, waren bislang unzureichend. Fehlende Werte, Dubletten, ungültige Adressen oder widersprüchliche Formate kosten Zeit, Geld und Vertrauen. Regelbasierte Systeme sind zu starr, manuelle Bereinigung ist zu teuer, und klassische Machine-Learning-Modelle erkennen zwar Muster, wissen aber nicht, wie sie korrigiert werden sollen.

Unser neues Whitepaper „Why Agentic Workflows Are the Breakthrough Enterprise Data Quality Has Been Waiting For“ zeigt, warum sich diese Situation jetzt grundlegend ändert.

Das Grundproblem: Warum Datenqualität so schwer zu automatisieren war

Datenqualität ist ein dreifaches Dilemma aus technischer Komplexität, semantischer Mehrdeutigkeit und schierer Skalierung. Daten liegen über viele Systeme verteilt – von SAP und Snowflake bis hin zu APIs und Data Lakes. Zu beurteilen, ob ein Datensatz korrekt ist, erfordert häufig Domänenwissen. Und die Anzahl möglicher Fehler ist faktisch unendlich. Dieses Zusammenspiel hat bisher verhindert, dass sich Datenqualität wirklich automatisieren ließ.

Der agentische Durchbruch: Reasoning at Scale

Agentic Workflows kombinieren Large Language Models mit Werkzeugzugriff, mehrstufigem Reasoning und autonomer Entscheidungsfindung. Sie können Ziele verfolgen („Vervollständige alle fehlenden Kundendaten“), Teilaufgaben planen, externe APIs nutzen, Zwischenergebnisse bewerten und aus Feedback lernen. Damit bringen sie erstmals menschliche Entscheidungslogikin skalierbare Systeme – und überwinden die Grenzen klassischer Automatisierung.

Vom Finden zum Verbessern – ein zweistufiger Workflow

In der ersten Phase identifizieren Agenten Datenprobleme mithilfe statistischer Profilierung, maschinellen Lernens und semantischer Kontextanalyse durch LLMs. In der zweiten Phase geht es um autonome Korrektur: Der Agent wählt Strategien, nutzt externe Tools oder Datenquellen, validiert seine Ergebnisse und verbessert sie bei Bedarf selbstständig. So entsteht ein durchgängiger Prozess vom Erkennen bis zur Verbesserung, ohne menschliche Eingriffe in jedem Einzelfall.

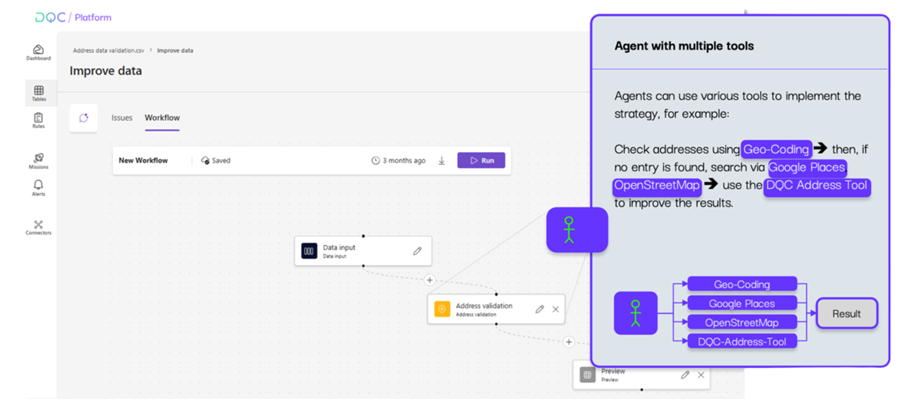

Konkretes Beispiel aus der DQC Platform (siehe Grafik):

Ein Agent bereinigt Adressdaten mit einem mehrstufigen Tool-Plan. Er prüft zunächst Einträge per Geo-Coding. Bleibt ein Ergebnis aus oder ist die Sicherheit zu niedrig, eskaliert er automatisch: Google Places → OpenStreetMap → DQC Address Tool. Nach jedem Schritt validiert der Agent Format, Länderspezifika und Koordinaten, setzt Confidence-Schwellen, protokolliert Entscheidungen und führt nur dann ein Update aus, wenn alle Validierungen bestanden sind. So entsteht ein robuster, wiederverwendbarer „Find → Improve“-Loop, der adressspezifische Edge Cases zuverlässig abdeckt – in großem Maßstab und mit vollständiger Auditierbarkeit.

Ein Agent bereinigt Adressdaten mit einem mehrstufigen Tool-Plan. Er prüft zunächst Einträge per Geo-Coding. Bleibt ein Ergebnis aus oder ist die Sicherheit zu niedrig, eskaliert er automatisch: Google Places → OpenStreetMap → DQC Address Tool. Nach jedem Schritt validiert der Agent Format, Länderspezifika und Koordinaten, setzt Confidence-Schwellen, protokolliert Entscheidungen und führt nur dann ein Update aus, wenn alle Validierungen bestanden sind. So entsteht ein robuster, wiederverwendbarer „Find → Improve“-Loop, der adressspezifische Edge Cases zuverlässig abdeckt – in großem Maßstab und mit vollständiger Auditierbarkeit.

Architektur für den produktiven Einsatz – über die Demo hinaus

Ein produktionsreifes agentisches System braucht mehr als nur KI-Modelle: Es muss Daten aus verschiedenen Quellen orchestrieren, kontextbewusst mit großen Datenmengen umgehen, wirtschaftlich skalieren und gleichzeitig zuverlässig bleiben. DQC.ai löst diese Herausforderungen mit einem universellen Datenzugriff, semantischer Kontextverwaltung, skalierbarer Architektur und einem Validierungsframework, das jede Entscheidung nachvollziehbar macht.

Warum jetzt? – Die technologische Konvergenz

Erst das Zusammenspiel aktueller Technologien – fortschrittlicher LLMs, zuverlässiger Tool-Use-Architekturen, schneller Vektordatenbanken und effizienter Cloud-Infra – macht Agentic Workflows heute möglich. Was vor zwei Jahren noch Forschungsvision war, ist nun marktreife Realität.

Warum DQC in diesem Markt baut

Der Markt für Datenqualität verändert sich rasant: Von der reinen Erkennung hin zur autonomen Behebung. Agentische Systeme senken Implementierungshürden, verstehen Anforderungen in natürlicher Sprache und ermöglichen Anwendungsfälle, die früher als „zu komplex zum Automatisieren“ galten.

Ein Blick in die Praxis

Wie das in der Praxis aussieht, vom Standardisieren von Millionen Adressen über das intelligente Zusammenführen von Dubletten bis zur Anreicherung von Produktdaten aus unstrukturierten Quellen, zeigt das Whitepaper anhand konkreter Projekte. Die Ergebnisse sind beeindruckend und machen das Potenzial agentischer Workflows greifbar. Mehr dazu in den Case Studies am Ende.