KI Agenten

Agentische Regelerstellung: Kontextbewusste Datenqualität im großen Maßstab

Datenqualitätsregeln sind die Grundlage vertrauenswürdiger Datensysteme. Sie erkennen Fehler, bevor sie sich ausbreiten, markieren Anomalien in Echtzeit und stellen die Einhaltung fachlicher Logiken sicher. Für die meisten Datenteams ist die Erstellung umfassender Regelsätze jedoch ein zeitaufwändiger, manueller Prozess, der sowohl tiefes Domänenwissen als auch technische SQL-Expertise erfordert.

Ein Data Engineer verbringt typischerweise Stunden damit, Tabellenschemata zu analysieren, Spaltenbeziehungen zu prüfen, Datenverteilungen zu profilieren und SQL-Abfragen zur Validierung der Geschäftslogik zu formulieren. Eine einzelne Tabelle kann mehr als 20 Regeln benötigen – etwa für Genauigkeit, Vollständigkeit, Aktualität und Konformität. Hochgerechnet auf Dutzende oder Hunderte Tabellen wird die Regelerstellung schnell zum Engpass.

Wir haben die agentische Regelerstellung von DQC entwickelt, um genau dieses Problem zu lösen. Statt stundenlanger manueller Arbeit generiert unsere Plattform kontextbewusste, umfassende Regelsätze in wenigen Minuten – ganz ohne eine einzige Zeile SQL.

Intelligenz, die Deine Daten versteht

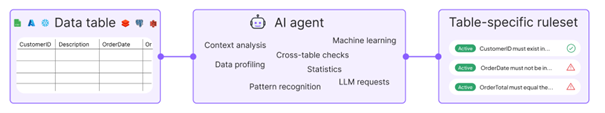

Wenn eine Datenquelle mit DQC verbunden und die Regelerstellung gestartet wird, läuft im Hintergrund kein generisches Template, sondern ein agentischer Workflow: ein koordiniertes Zusammenspiel aus statistischer Analyse, Machine-Learning-Algorithmen und Large Language Models, die gemeinsam den spezifischen Datenkontext verstehen.

Der Prozess beginnt mit einer Kontextanalyse. Unsere LLMs untersuchen Tabellen- und Spaltennamen, Datentypen, Beispielwerte und Metadaten, um zu verstehen, um welche Art von Daten es sich handelt. Ist es eine SAP-MARA-Materialstammtabelle? Eine Snowflake-Kundendatenbank? Eine E-Commerce-Bestelltabelle in BigQuery? Die Antwort bestimmt grundlegend, welche Regeln sinnvoll sind.

Sobald der Kontext feststeht, starten mehrere parallele Workflows: Sie analysieren Spaltenstatistiken, untersuchen Beziehungen zwischen Spalten und nutzen Machine Learning zur Mustererkennung. Währenddessen orchestrieren LLMs den Gesamtprozess und priorisieren Prüfungen abhängig von der Rolle der Tabelle im Datenökosystem.

Genau das macht das System agentisch: Es passt seinen Ansatz dynamisch an die erkannten Strukturen an. Eine E-Mail-Spalte löst Format- und Musterprüfungen aus. Eine Betrags-Spalte führt zu Bereichsvalidierungen und Abgleichen über Tabellen hinweg. Eine Zeitstempel-Spalte aktiviert Aktualitäts- und zeitliche Konsistenzregeln.

Vom Kontext zur umfassenden Abdeckung

Ein Praxisbeispiel: die Bestelltabelle eines Handelsunternehmens in BigQuery. Die Plattform erkennt zentrale Geschäftslogiken wie OrderDate, OrderTotal, CustomerID und OrderStatus und generiert innerhalb weniger Minuten Regeln wie:

• Zeitliche Plausibilität: OrderDate darf nicht in der Zukunft liegen

• Referenzielle Integrität: CustomerID muss in der Kundentabelle existieren

• Geschäftslogik: OrderTotal muss der Summe der zugehörigen Positionswerte entsprechen (tabellenübergreifende Konsistenz)

• Statuskonformität: OrderStatus muss einem definierten Wertebereich entsprechen

• Vollständigkeit: Kritische Felder wie CustomerID und OrderTotal dürfen nicht null sein

• Aktualität: Neue Bestellungen müssen innerhalb erwarteter Zeitfenster erscheinen

In einem anderen Kontext – etwa einer PostgreSQL-Tabelle für Benutzer-Authentifizierung – sähen die Regeln völlig anders aus: Validierung von Passwort-Hash-Formaten, E-Mail-Musterprüfungen, Logik zur Kontoerstellung oder Erkennung verdächtiger Login-Versuche.

Besonders hervorzuheben ist die tabellenübergreifende Konsistenzprüfung. Sie gehört zu den aufwendigsten Validierungen in der manuellen Erstellung. Im Bestellbeispiel versteht das System, dass OrderTotal mit den Positionsdaten in einer separaten Tabelle abgeglichen werden muss. Join-Logik und Prüfregeln werden automatisch generiert – und decken Abweichungen auf, die auf Pipeline-Probleme oder Berechnungsfehler hinweisen können.

Zwei Wege zu intelligenten Regeln

Die agentische Regelerstellung ist auf zwei Arten zugänglich.

Der Button zur Regelvorhersage ermöglicht mit einem Klick eine vollständige Abdeckung. Nach Verbindung der Datenquelle wird innerhalb weniger Minuten ein umfassender Regelsatz erzeugt, der Genauigkeit, Vollständigkeit, Aktualität und Konformität abdeckt. Ideal für das Onboarding neuer Datenquellen oder den schnellen Aufbau eines Qualitätsmonitorings.

Der DQ-AI Assistant bietet einen dialogorientierten Ansatz. Es können gezielt Regeln angefragt werden, etwa: „Schlage Vollständigkeitsprüfungen für Kundendaten vor“ oder „Welche Konsistenzregeln sollte es zwischen Bestellungen und Lagerbestand geben?“ Der Assistant nutzt denselben agentischen Workflow, passt die Ergebnisse jedoch individuell an die Anfrage an.

Beide Wege machen SQL-Expertise überflüssig. Mehr als 90 % der Regeln sind No-Code und damit auch für Fachbereiche und Analysten nutzbar – unabhängig vom technischen Hintergrund.

Der Wandel von manuell zu agentisch

Die Umstellung von manueller Regelerstellung auf agentische Automatisierung ist mehr als nur ein Effizienzgewinn – auch wenn die Reduktion von zehn Minuten auf 30 Sekunden erheblich ist. Es geht um Demokratisierung.

Früher waren umfassende Regelsätze spezialisiertes SQL-Wissen und statistisches Know-how vorbehalten. Heute ist dieses Wissen im System selbst verankert.

Datenteams können sich auf ihre Kernaufgaben konzentrieren: Geschäftsanforderungen verstehen, Qualitätsprobleme analysieren und Entscheidungen zur Datenverbesserung treffen. Die technische Übersetzung in Validierungsregeln erfolgt automatisch.

Live erleben

Die agentische Regelerstellung ist ab sofort auf der DQC Plattform verfügbar. Wer sehen möchte, wie kontextbewusste Automatisierung Initiativen zur Datenqualität beschleunigen kann, erhält gerne eine Live-Demonstration mit eigenen Daten.

Kontakt aufnehmen und erleben, wie agentische Intelligenz den Umgang mit Datenqualität grundlegend verändert.

Wollen Sie es live sehen?

Buchen Sie einfach einen Termin